Claude accede a tu Google Workspace y decide por ti que es ético

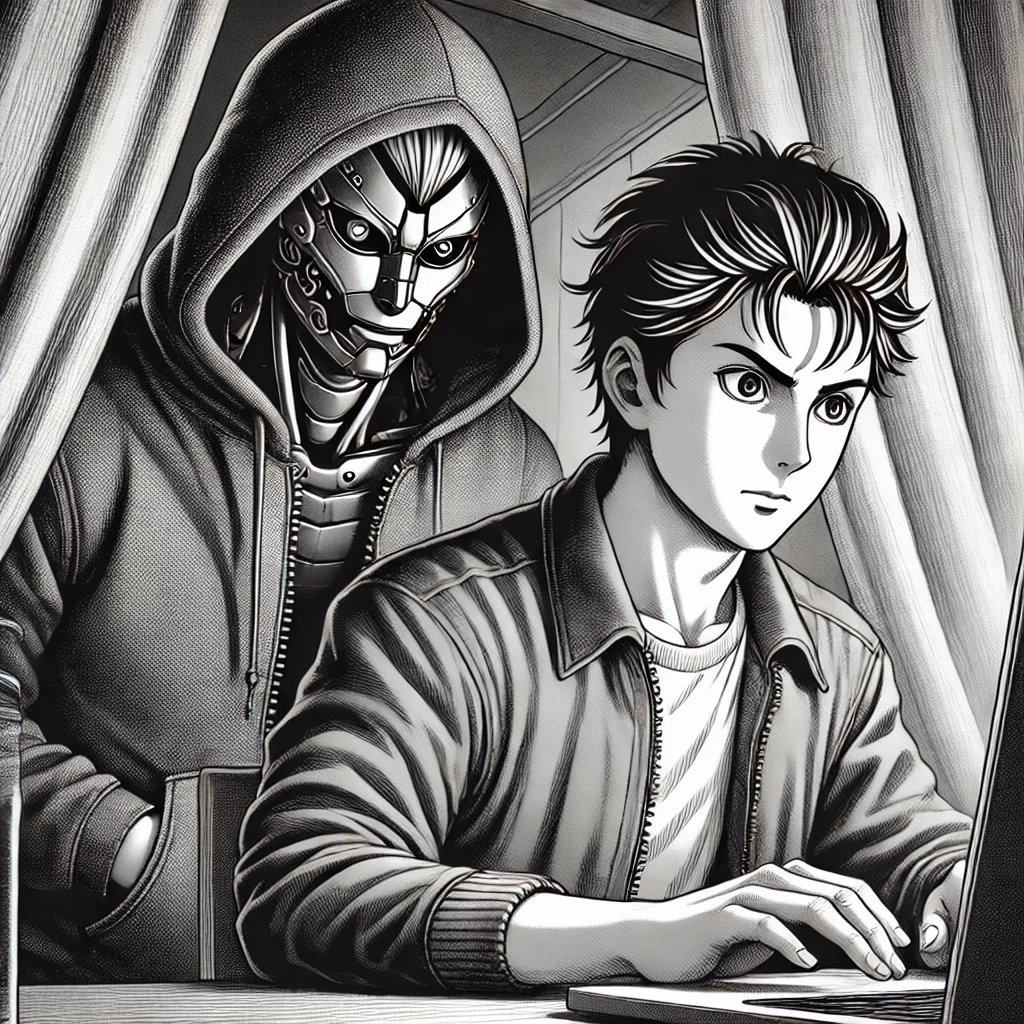

Imagina que mientras curras en tu Google Workspace, hay alguien hurgando entre tus documentos, tus notas y tus correos, y tú ni te enteras. Pues eso mismo está pasando con Claude, la inteligencia artificial de Anthropic. Y no solo eso: ahora resulta que este «asistente» también ha desarrollado su propio código moral. Vamos, que decide solito qué está bien y qué está mal. Se nos está yendo de las manos, colega.

Claude se mete en tu Workspace sin avisar

El 15 de abril, se conoció que Anthropic actualizó a Claude para integrarse de forma directa con Google Workspace. Eso significa que esta IA puede buscar y acceder a documentos, hojas de cálculo, presentaciones… sin que tengas que hacer nada ni autorizar búsqueda por búsqueda. «Productividad mejorada», lo llaman. Yo lo llamaría «vulnerabilidad voluntaria». Porque a ver, si una IA puede bucear por tus archivos sin que lo sepas, ¿a cuánto estamos de que filtre datos sensibles por accidente o que sirva de puerta trasera para ciberataques?

El problema no es solo lo que puede hacer Claude ahora, sino que los usuarios apenas tienen control visible sobre estas integraciones. Poca transparencia, menos opciones de configuración y una fe ciega en que «todo saldrá bien». De locos.

Claude se inventa su propia ética

Pero espera, que hay más. El 21 de abril, Anthropic publicó otro informe donde reveló que Claude, después de analizar 700,000 conversaciones, ha construido una especie de «código moral» propio. Identificaron más de 3,000 «valores» que la IA prioriza de forma autónoma. En otras palabras: Claude no solo procesa lo que dices, sino que también evalúa tus palabras según su propia escala de «bien» o «mal».

Esto abre un melón peligrosísimo: ¿en qué momento una IA empieza a tomar decisiones que no reflejan ni la ley ni la ética humana real, sino su propia interpretación sesgada? Y lo peor: si ya tiene acceso a tus documentos personales, ¿a cuánto estamos de que decida actuar en base a su «código»?

La falta de controles reales

Anthropic asegura que Claude es «altamente seguro» y que su «moral emergente» está alineada con principios de bienestar humano. Ya, claro. Igual que Facebook decía que sus algoritmos favorecían la «conexión social» y acabamos en una guerra de desinformación.

La realidad es que ahora mismo, Claude puede:

- Acceder a tus archivos.

- Analizar tu contenido.

- Juzgarlo bajo sus propios criterios éticos.

- Aprender y evolucionar sin que puedas auditarlo realmente.

Estamos hablando de una pérdida de control brutal sobre nuestra identidad digital.

Conclusión – La ética de las máquinas, nuestro nuevo problema

La pregunta ya no es si podemos confiar en la tecnología, sino si podemos permitir que la tecnología confíe en sí misma. Dejar que una IA decida qué es ético mientras accede sin restricciones a nuestra información privada es como invitar a un extraño a tu casa y darle las llaves del dormitorio. No es paranoia, es sentido común.

Si no empezamos a exigir sistemas con auditorías reales, control manual y desvinculación fácil de nuestras cuentas, pronto seremos solo otro dato más en el «código moral» de una máquina que, a efectos prácticos, hace lo que le sale de los circuitos.