Antes de preguntar a ChatGPT, deberías leer esto

Tengo que confesarte una cosa, compañero.

A veces cuando te escucho o leo decir la típica frase de “le he preguntado a ChatGPT y me ha dicho esto”, aunque no te lo diga, me hierve la sangre.

No es culpa tuya.

Tienes una imagen equivocada de la IA. Una imagen que dictan aquellos a los que algunos llaman los 7 fantásticos y que cala desde los medios que repiten el mensaje una y otra vez, normalmente copiando y pegando las mismas notas.

Tras leer este artículo, tu uso de la inteligencia artificial podrá ser mucho más eficiente.

Sin pagar ningún curso.

Sin comprar acceso a listas de prompts milagrosos.

La primera farsa: “Inteligencia Artificial”

Vamos a empezar por el principio. El propio nombre: Inteligencia Artificial.

Queda muy fulero y vende que flipas.

A día de hoy, la Narrow AI (IA especializada en hacer una tarea concreta) tiene de inteligencia cero.

La IA general aún no existe.

Y no, ChatGPT no es una IA general. Es una IA conversacional.

Aunque ponga “Thinking”, no está razonando.

Está calculando qué palabra encaja mejor a continuación.

¿Has escuchado alguna vez que Sora u otros modelos de vídeo son creadores de mundos?

Suena espectacular, pero ninguna tecnología actual comprende el mundo real.

No hay experiencia, no hay contexto físico, no hay sentido común. No hay mundo ahí dentro.

Primer consejo: no te engañes con lo que tienes delante

Cuando estés delante de un modelo de lenguaje y pretendas usarlo, por mucho que parezca ese amigo, profesor o fuente de conocimiento infinito que siempre deseaste tener, no te engañes.

Es una máquina.

Y funciona de una forma muy concreta:

completa huecos con lo que estadísticamente encaja.

Todo lo demás deriva de ahí.

Un embaucador exitoso

Las respuestas suelen ser fascinantes, bien escritas y convincentes.

Eso es justo lo que las hace peligrosas.

Si sobre lo que preguntas hay suficiente información en su entrenamiento, la respuesta suele ser bastante acertada.

Si no la hay, empieza a mezclar datos reales con otros inventados, pero tan bien hilados que cuesta distinguirlos.

Su prioridad no es acertar.

Es responder.

El ejemplo de la nave espacial

Esto se ve muy claro cuando pruebas modelos pequeños de unos 4B de parámetros en local.

Les pides que diseñen una nave espacial que viaje por agujeros de gusano y, en segundos, te dan un tutorial paso a paso para construirla en el garaje de tu casa.

Con explicaciones detalladas de cómo abrir el agujero de gusano usando una pila de botón y el muelle de un bolígrafo.

Todo falso.

Todo coherente.

Todo muy convincente.

A eso se le llama alucinaciones.

No es un fallo puntual. Es el resultado de cálculos algorítmicos y probabilísticos extremadamente complejos.

Modelos pequeños, modelos grandes y dónde está la diferencia real

Tengo un entorno de pruebas donde uso modelos de 14B o 20B, pequeño en hardware humilde y, para ciertas tareas, da mejores resultados que modelos mucho más avanzados corriendo en bestias de computación.

La gran diferencia no está tanto en el “razonamiento” como en el conocimiento con el que han sido entrenados.

En muchas tareas de lógica o cálculo, los modelos pequeños y los grandes se parecen más de lo que la gente cree.

Cuando el modelo no sabe de lo que habla

En radioafición, por ejemplo, ChatGPT anda bastante perdido.

Es un tema en el que los fallos saltan rápido.

Como cuando le pedí información sobre los requisitos técnicos de los repetidores en España.

Menudo desastre.

Seguro que estás pensando:

Acuántico, macho, si ahora el GPT tiene búsqueda en internet…

BOE, leyes y búsquedas que salen mal

Para mí, el BOE es el santo grial. O casi.

Cuando escribo sobre normativa, voy siempre a fuentes oficiales.

No a interpretaciones de terceros.

No a artículos refritos.

El problema es que ni siquiera en el BOE, muchas veces, la respuesta es clara.

El GPT con las leyes se vuelve loco.

Busca una ley, la escupe como verdad absoluta y, cuando contrastas nada cuadra, resulta que estaba derogada.

Y esto ocurre incluso usando búsqueda directa.

Si preguntas algo más general, el panorama empeora:

medios que copian y pegan lo que dice la agencia F o, directamente, respuestas sacadas de un subforo de Reddit donde Nabo26cm escribió borracho a las seis de la mañana desde un Uber de vuelta a casa.

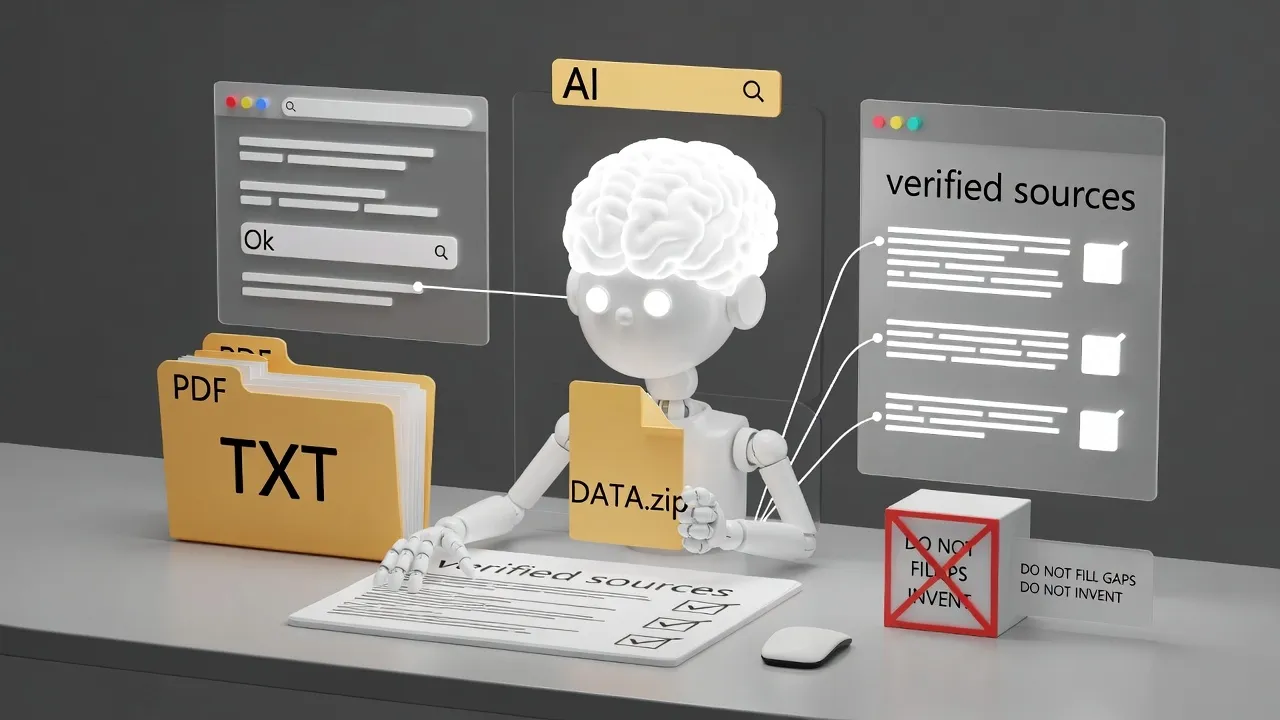

Lo que los modelos de lenguaje hacen bien

Si hay algo que estos modelos hacen bien es trabajar con datos.

Pero solo si se los das tú.

Haz una primera búsqueda.

Revisa lo que devuelve.

Contrasta lo que parezca serio.

Cuando tengas información decente, guárdala en archivos: TXT, PDF, lo que sea.

Si son muchos, en un ZIP.

Súbesela y entonces sí.

Ahora pregúntale algo.

No es que se vuelva más listo.

Es que ya no tiene que rellenar huecos.

Esto sirve para todo

Software, leyes, radio.

Si el modelo se equivoca al ayudarte con un programa, dale la documentación oficial de ese programa.

Si haces una consulta legal, dale directamente el texto de la ley que aplica a tu caso.

Y si vas a configurar una emisora de radioaficionado, súbele el manual del equipo.

Funciona mejor porque trabaja con contexto, no porque “sepa más”.

El error más grave: compartir datos sensibles

Otra cosa que te he visto hacer muchas veces es compartir datos sensibles.

Da igual si son cuentas de empresa, una analítica médica o problemas personales.

Todo eso se registra, se clasifica y se almacena.

Hoy parece inocente.

Mañana puede pasarte factura.

En entornos empresariales se usan modelos locales por una razón.

Los particulares somos mucho más confiados.

Y bastante más incautos.

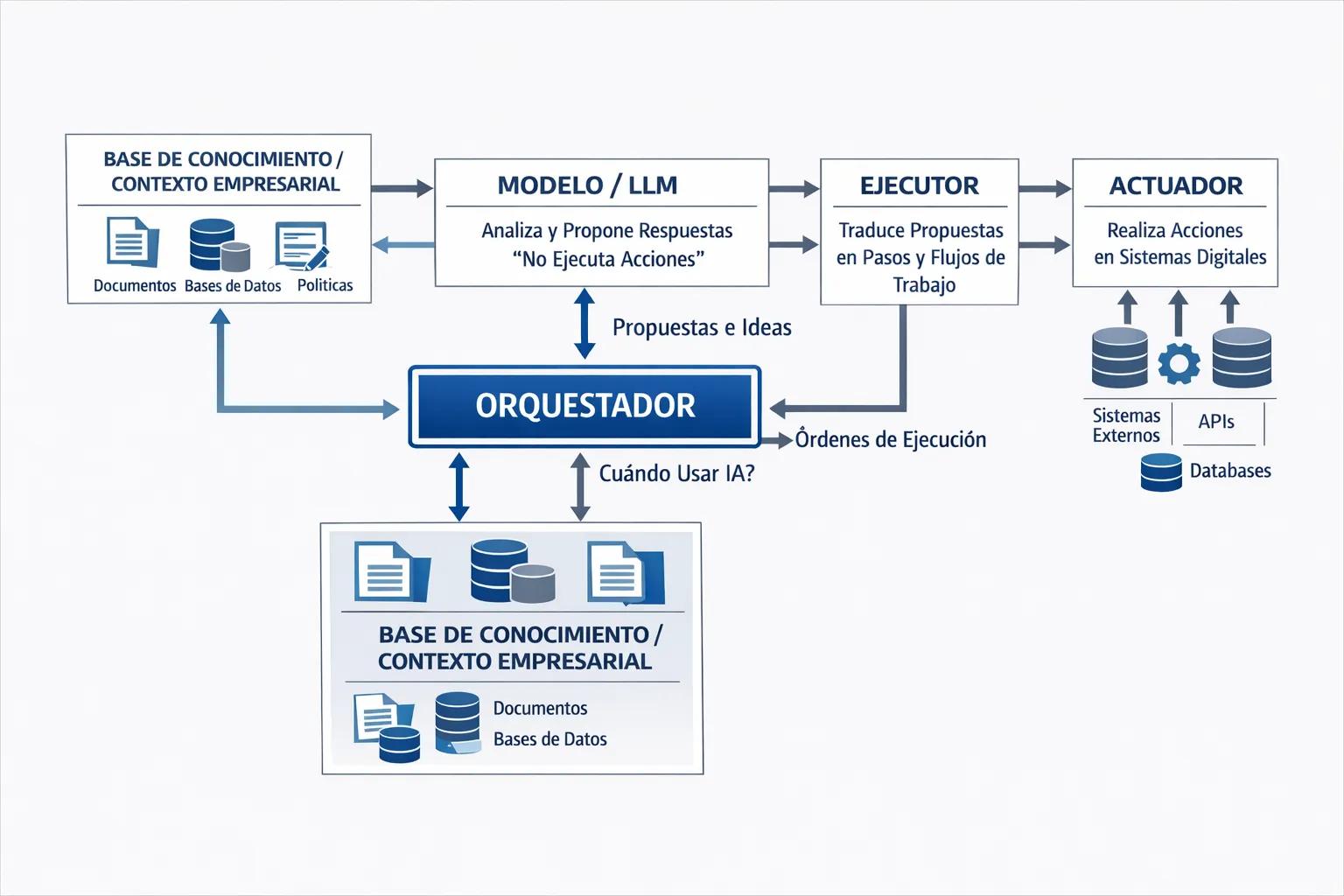

Cómo funciona esto en entornos empresariales

En empresas se usan sistemas que conectan y coordinan distintos servicios.

Algo parecido a lo que hace n8n: no es una sola IA haciendo de todo, sino varias piezas trabajando juntas.

Hay cinco partes claras.

El orquestador es el que manda. Decide cuándo tiene sentido usar la IA y qué información hay que ponerle delante.

El modelo recibe eso y propone una respuesta o una decisión. No actúa, solo sugiere.

El ejecutor coge esa propuesta y la convierte en pasos concretos: qué hacer, en qué orden y con qué sistemas.

El actuador es quien ejecuta la acción final en el mundo real: tocar datos, lanzar procesos o cambiar algo de verdad.

Y todo eso se apoya en una base de conocimiento propia, con información específica del negocio.

Los resultados son mejores no porque el modelo sea más listo, sino porque no trabaja a ciegas: tiene el contexto adecuado delante y unos guías que lo orientan.

Cómo suelo preguntar yo

Con el tiempo me di cuenta de que muchas respuestas malas no vienen de que el modelo sea malo, sino de que la pregunta lo es.

Cuando preguntas algo al aire, rellena huecos.

Y ahí empiezan los problemas.

No es lo mismo decir:

“Explícame esta ley”

que decir:

“Con esta ley delante, quiero saber si en este caso concreto puedo hacer X.

Y dime también qué no está claro.”

Ahí no le pido que decida por mí.

Refuerzo su objetivo.

Cuando le pido que trabaje, no que responda

Muchas veces no le pido una respuesta directa.

Le pido que me diga:

- qué información le falta

- qué está asumiendo

- dónde puede haber ambigüedad

Eso cambia la dinámica.

Deja de sonar tan segura.

Empieza a mostrar sus flaquezas.

Y cuando ves sus flaquezas, sabes por dónde tirar tú.

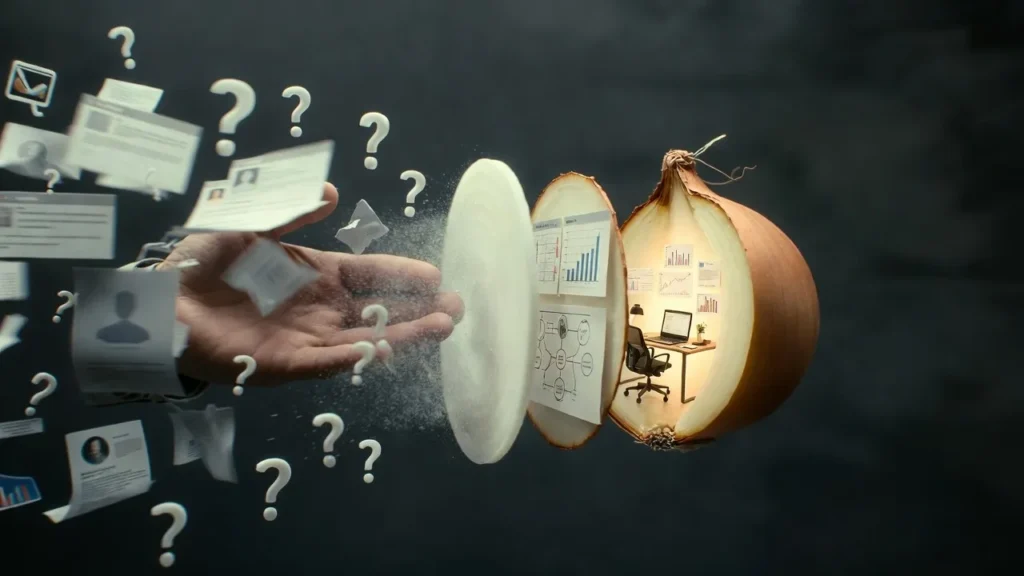

Usarla por capas es lo que marca la diferencia

Cuando el modelo ya te ha enseñado sus límites, es cuando tiene sentido usarlo por capas.

Primero, búsqueda general.

Después, filtro humano.

Luego, ordenación.

Y solo al final, trabajo fino con los datos.

Si te saltas pasos, el modelo rellena huecos.

Si vas por capas, los huecos los rellenas tú.

Esa es la diferencia entre usar la IA y limitarte a consultarla.

Si tengo que dejarte un resumen

Si tuviera que resumir todo esto en algo práctico, sería esto:

No le preguntes a la IA lo que no puedes contrastar.

No le pidas que decida por ti.

Dale contexto antes de pedir conclusiones.

Haz que te diga qué no sabe.

Y usa sus respuestas como material de trabajo, no como verdad.

Con eso, la IA deja de engañar.

No porque haya cambiado ella.

Sino porque has cambiado tú.

Si te ha gustado este artículo, tienes mas relacionados en TechLab y Tutoriales:

Guía Tutorial de Instalación y uso de LM Studio para modelos de lenguaje locales

Inteligencia artificial y el futuro humano

IA Local vs IA en la Nube: privacidad, potencia y límites reales