Cómo funciona un detector de IA: la historia del fingerprinting que intenta decidir si tú escribiste tu propio texto

Hay una escena que se repite cada día.

Un estudiante entrega un trabajo. Una periodista publica un reportaje. Un redactor sube un artículo. Todo parece normal… hasta que aparece un mensaje en pantalla:

“Probabilidad de contenido generado por IA: 87%”

Sin explicación. Sin contexto. Sin derecho a réplica.

Como si un algoritmo hubiera leído tu texto y, en su infinita sabiduría estadística, hubiera decidido que no eres tú.

Así funciona la nueva fiebre por detectar IA. Una mezcla de prisas, miedo, desconocimiento y una confianza ciega en herramientas que no entienden el lenguaje, pero actúan como si pudieran leer el alma del escritor.

Este TechLab es la historia de cómo llegamos aquí… y por qué el sistema falla.

1. El origen del problema: querer medir lo que no se puede medir

Todo empieza con una pregunta que parecía inocente:

“¿Podemos distinguir un texto humano de uno creado por IA?”

Científicamente, la respuesta correcta es: no, al menos no de forma fiable.

Pero la industria quiso intentarlo igualmente. Y así nació el “fingerprinting”, un conjunto de técnicas que prometían identificar la autoría oculta en cualquier texto.

Suena sofisticado, casi detectivesco. Pero basta abrir la tapa para ver engranajes más frágiles de lo que nos quieren hacer creer.

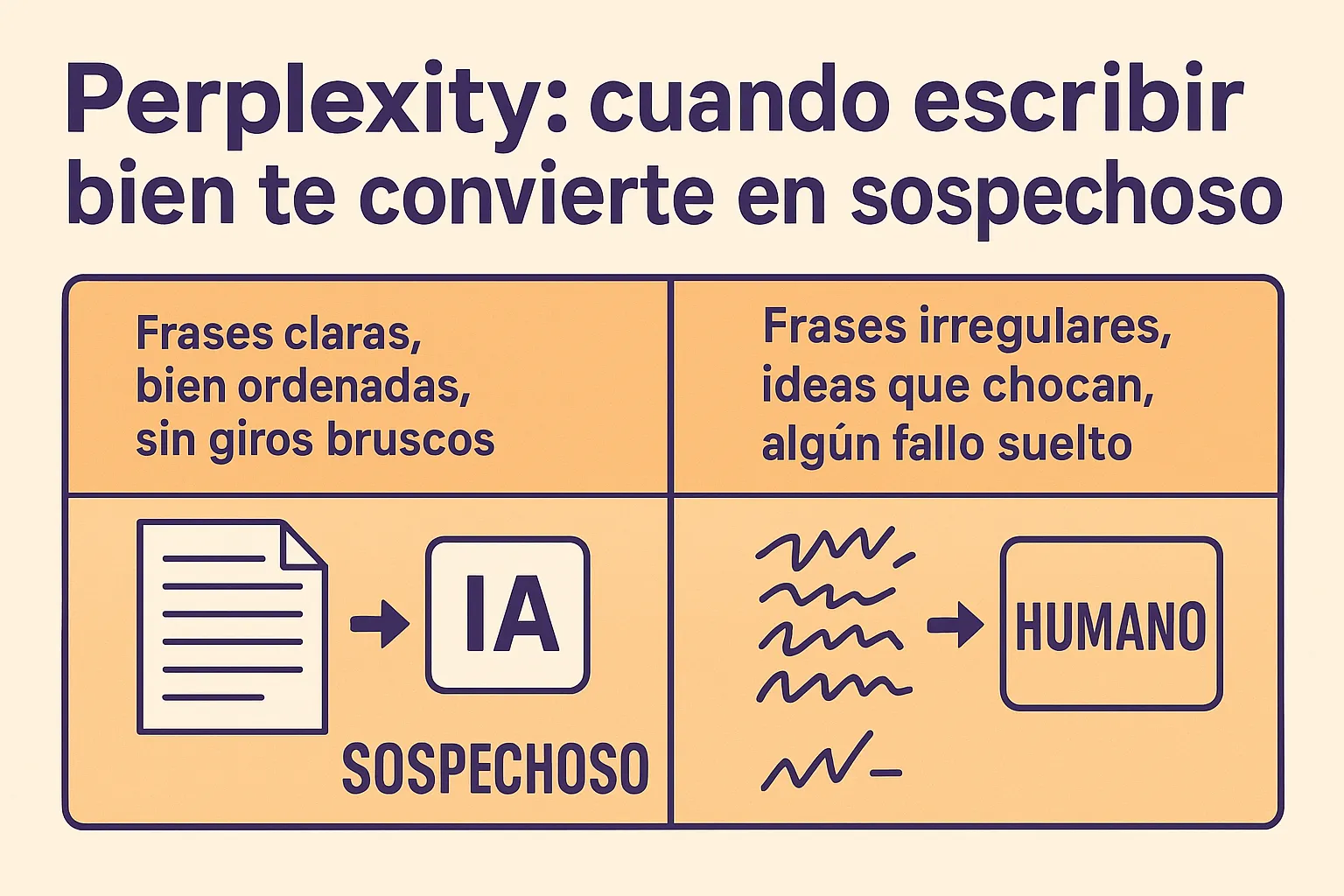

2. Perplexity: cuando escribir bien te convierte en sospechoso

La primera técnica que adoptaron los detectores fue analizar lo “predecible” que es un texto.

A esto lo llaman perplexity, una métrica que suena a física cuántica pero se comporta como un perro rastreador sordo.

Imagínate delante de un detector que te evalúa así:

- Si escribes con frases claras, bien ordenadas, sin giros bruscos → IA.

- Si te salen frases irregulares, ideas que chocan entre sí, algún fallo suelto → humano.

El detector no busca inteligencia: busca ruido.

Ese ruido natural de la escritura humana que desaparece cuando corriges tu texto o lo editas con una IA.

Por eso no es raro que un artículo trabajado marque como IA mientras un texto mediocre pasa como humano sin discusión.

3. Burstiness: el ritmo que decide si “piensas demasiado bien”

La segunda técnica es la burstiness, que analiza el ritmo del texto.

Los humanos, al escribir, aceleramos y frenamos sin darnos cuenta.

Pero los modelos de IA, hasta 2022, mantenían un ritmo casi perfecto.

¿El problema?

En 2025 los modelos son capaces de imitar el caos humano bajo demanda.

Puedes pedirles frases cortas, largas, desordenadas, con subidas y bajadas de tono.

Y lo hacen mejor que muchos humanos.

Así que la “prueba de ritmo” ahora sirve para detectar… nada en concreto.

4. Watermarking: la marca de agua que desaparece con solo respirar

Hubo un momento en que la comunidad creyó haber encontrado la solución definitiva: poner marcas invisibles (watermarks) en los textos generados por IA.

Una idea elegante:

si la IA deja un rastro matemático, podremos descubrir si ella generó el texto.

Pero aquí viene el giro:

- si traduces el texto → watermark roto

- si lo resumes → roto

- si reordenas ideas → roto

- si lo mezclas con texto humano → roto

- si lo pasas por un modelo que no usa watermark → inexistente

Esta fragilidad está documentada en estudios como este.

Y para rematar:

la mayoría de modelos abiertos (Llama, Mistral, GPT-J, GPT-OSS) NO llevan watermark.

Es como intentar identificar criminales por su perfume… cuando la mitad usa colonia y la otra mitad no se duchó.

Este método no es teórico: fue descrito en detalle en el estudio de Kirchenbauer et al. (2023), donde se propone dividir el vocabulario en tokens “verdes” y “rojos”.

5. El fingerprinting estilístico: buscar huellas donde no las hay

La tercera técnica intenta identificar patrones estilísticos.

Un movimiento sutil, casi literario: analizar la forma en que conectas ideas, cómo usas los adjetivos, la estructura de tus frases, incluso cómo un modelo tokeniza tus palabras.

Sobre el papel parece brillante.

Hasta que recuerdas dos detalles:

- Los humanos no tenemos estilo único.

- Las IA pueden imitar cualquier estilo si se lo pides.

Esto convierte la tarea en un juego infinito del gato y el ratón.

Un detector entrenado en GPT-3.5 no puede reconocer ni a GPT-4 ni a Llama 3.

Y mucho menos a los modelos abiertos, finetuneados, modificados o mezclados por la comunidad.

El resultado:

un detector que intenta reconocer sombras moviéndose en la pared.

6. La tragedia oculta: los falsos positivos

Aquí llegamos al punto más doloroso.

La mayor parte del daño que hacen estos detectores no es fallar al identificar IA.

Es fallar al identificar humanos.

Un estudio publicado en Education Integrity confirma este patrón de falsos positivos en contextos educativos reales.

¿Quiénes son los más castigados?

- personas que escriben muy bien,

- estudiantes no nativos,

- redactores que siguen normas SEO,

- periodistas que corrigen estilo,

- y cualquiera que use IA como editor, no como autor.

Y es que cuando una IA corrige un texto humano, suaviza su irregularidad natural.

Eso basta para que el detector lo clasifique como IA generativa.

Claro:

no sabe distinguir edición de autoría.

Cree que un texto pulido es “demasiado perfecto para un humano”.

Una idea ofensiva, pero real en el mundo de los detectores.

7. El impacto de los modelos abiertos: caos en el registro de huellas

Hasta aquí, los detectores intentaban seguir el ritmo de los grandes modelos comerciales.

Pero llegó la revolución OSS: Llama, Mistral, GPT-J y un ejército de variantes afinadas en casa, mezcladas, recortadas, adaptadas a nichos y lanzadas sin watermark.

El fingerprinting se colapsó.

No existe una “firma universal” que estos modelos compartan.

Cada uno escribe como quiere, según quién lo haya entrenado o cómo.

Es como intentar reconocer a un artista por su pincelada… pero ahora millones de artistas comparten el mismo pincel.

8. El punto ciego que deberíamos temer: vigilancia del estilo

Más allá de lo técnico, hay una cuestión social que rara vez se menciona:

si tu estilo puede usarse para juzgarte, entonces escribir se convierte en un acto vigilado.

Ya no se evalúa el contenido, sino su “origen probabilístico”.

Se penaliza el texto pulido.

Se sospecha del que escribe con claridad.

Y se obliga a justificar la autoría como si cada frase fuera una prueba ante un tribunal.

En lugar de proteger la integridad académica, los detectores están creando un clima de desconfianza sobre el lenguaje.

Y eso sí debería preocuparnos.

El detector no detecta IA, detecta patrones… y los confunde

Después de revisar perplexity, burstiness, watermarking, estilometría y el caos del ecosistema moderno, la conclusión es tan simple como demoledora:

Un detector de IA no identifica autoría; clasifica probabilidades.

No mide si tú escribiste el texto; mide si tu estilo se parece al de una IA.

Y en 2025, escribir bien se parece demasiado a escribir “como una IA”.

Los detectores generan falsa seguridad, falsas acusaciones y una sensación creciente de vigilancia.

No son una herramienta neutral.

Y no deberían dictar sentencias sobre trabajos humanos.

OpenAI retiró oficialmente su AI Text Classifier en 2023 por su baja precisión y alta tasa de falsos positivos.

Incluso universidades estadounidenses recomiendan no usar detectores como prueba concluyente, como explica Illinois State University.

El lenguaje merece algo mejor que un semáforo digital.

Si te ha gustado este artículo, tienes mas relacionados en TechLab y Tutoriales:

Guía Tutorial de Instalación y uso de LM Studio para modelos de lenguaje locales

Cómo usé una IA para crear una IA que creó un software espía con IA

IA Local vs IA en la Nube: privacidad, potencia y límites reales